网站 seo 方面博大精深,小天对这方面了解的也不是很多,所以有点班门弄斧的意思。这里只希望把最近遇到的一个关于 seo 的问题分享给大家,希望对大家有所帮助。要做好 seo,为了优化好网站,分析了解蜘蛛的爬行动向,清楚地了解蜘蛛爬行规律也是很重要的。

今天要实现的这个功能就是把蜘蛛的爬行记录列出来,生成一个日志,以方便站长们分析统计蜘蛛动向。当然对于这个功能有一款相应的 WordPress 插件,比如:wp-log-robots。但是我的原则是能不用插件就不用插件,所以在此给大家分享的是无插件代码版的获取蜘蛛抓取日志。

首先,找到 wordpress 主题文件目录下的 functions.php 文件,用代码编辑软件打开,在最后一个 ?>之前添加以下代码:

- /**

- * WordpPress 非插件纯代码获取蜘蛛来访日志

- * http://www.ilxtx.com/how-to-get-spiders-logs.html

- */

- function get_naps_bot(){

- $useragent = strtolower($_SERVER[‘HTTP_USER_AGENT’]);

- if (strpos($useragent, ‘googlebot’) !== false){ return ‘Googlebot’; }

- if (strpos($useragent, ‘msnbot’) !== false){ return ‘MSNbot’; }

- if (strpos($useragent, ‘slurp’) !== false){ return ‘Yahoobot’; }

- if (strpos($useragent, ‘baiduspider’) !== false){ return ‘Baiduspider’; }

- if (strpos($useragent, ‘sohu-search’) !== false){ return ‘Sohubot’; }

- if (strpos($useragent, ‘lycos’) !== false){ return ‘Lycos’; }

- if (strpos($useragent, ‘robozilla’) !== false){ return ‘Robozilla’; }

- return false;

- }

- function nowtime(){

- date_default_timezone_set(‘Asia/Shanghai’);

- $date=date(“Y-m-d.G:i:s”); return $date;

- }

- $searchbot = get_naps_bot();

- if ($searchbot) {

- $tlc_thispage = addslashes($_SERVER[‘HTTP_USER_AGENT’]);

- $url=$_SERVER[‘HTTP_REFERER’];

- $file=“robotslogs.txt”;

- $time=nowtime();

- $data=fopen($file,“a”);

- $PR=“$_SERVER[REQUEST_URI]”;

- fwrite($data,“Time:$time robot:$searchbot URL:$tlc_thispage\n page:$PR\r\n”);

- fclose($data);

- }

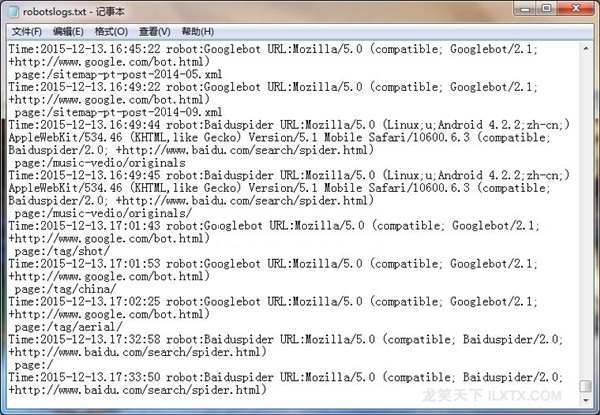

接着,再在网站的根目录新建一个 robotslogs.txt 的文本文件用来存放日志,权限设置为 777,然后访问该文件(http://你的网站域名/robotslogs.txt)就可以看到蜘蛛的爬行记录了。再把这个地址存为浏览器书签就能很方便的随时查看了!效果图如下:

桂公网安备 45010502000016号

桂公网安备 45010502000016号